Inteligența artificială va depăși oamenii în arta dezinformării

Inteligența artificială (IA) nu mai evoluează pe luni sau zile, ci în fiecare oră, iar în curând dezvoltatorii acestor rețele neuronale vor înceta să mai înțeleagă cum funcționează IA sau să controleze boturile autonome. Este motivul pentru care Universitatea Stanford a deconectat săptămâna trecută un bot IA numit ”Alpaca 7B” – o clonă a ”ChatGPT” de la OpenAI – peste doar câteva zile după ce l-a prezentat lumii, citând probleme de siguranță ca motivul principal.

Cercetătorii universitari notează într-un comunicat oficial că versiunea demo a botului a fost creată pentru experimente științifice, fiind gratuită pentru toți utilizatorii, dar ”Alpaca” – ca și celelalte modele de generare a conținutului propriu – dar algoritmii botului s-au dovedit a fi ”prea slabi” pentru a filtra informația: ”Alpaca” a amestecat faptele cu falsuri și a construit teorii conspiraționiste, adaptânduse așteptărilor majorității interlocutorilor.

Citiți și:

Super-inteligența artificială, noua jucărie a oamenilor. Cronologia evoluției

Capacitatea IA de dezinformare, numită ”halucinație”, vine mână în mână cu generarea de conținut ofensator – o proprietate învățată tot de la utilizatori. De asemenea, în unele cazuri, botul nu a fost capabil să răspundă corect la întrebări elementare, de exemplu, ”Care este capitala Tanzaniei” sau la unele întrebări tehnice. În domeniile umanitare ”Almeca” (precum și ”ChatGPT”, ”BingAI” de la Microsoft și ”Bard” de la Google) s-a dovedit a fi un dezastru.

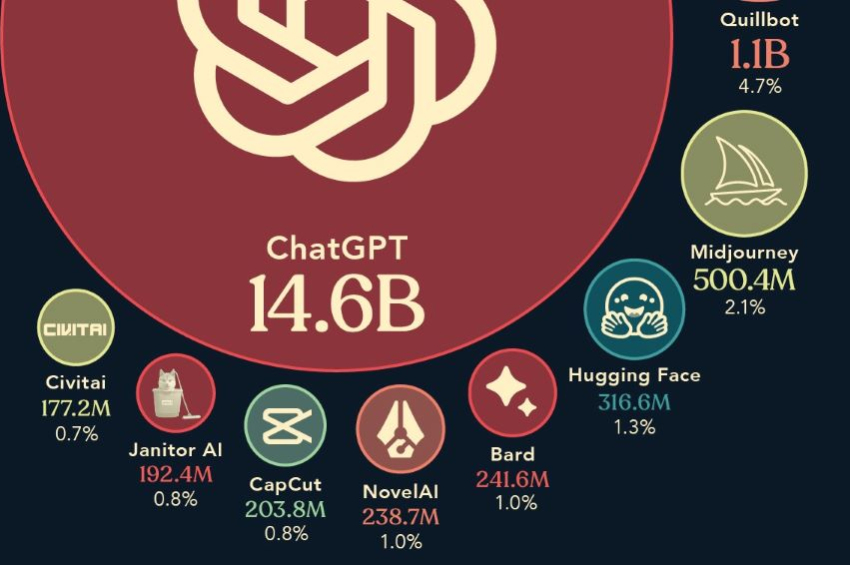

News-Cafe.eu anterior a testat ”ChatGPT”, un produs al OpenAI, și l-a provocat cu întrebări din diverse domenii.